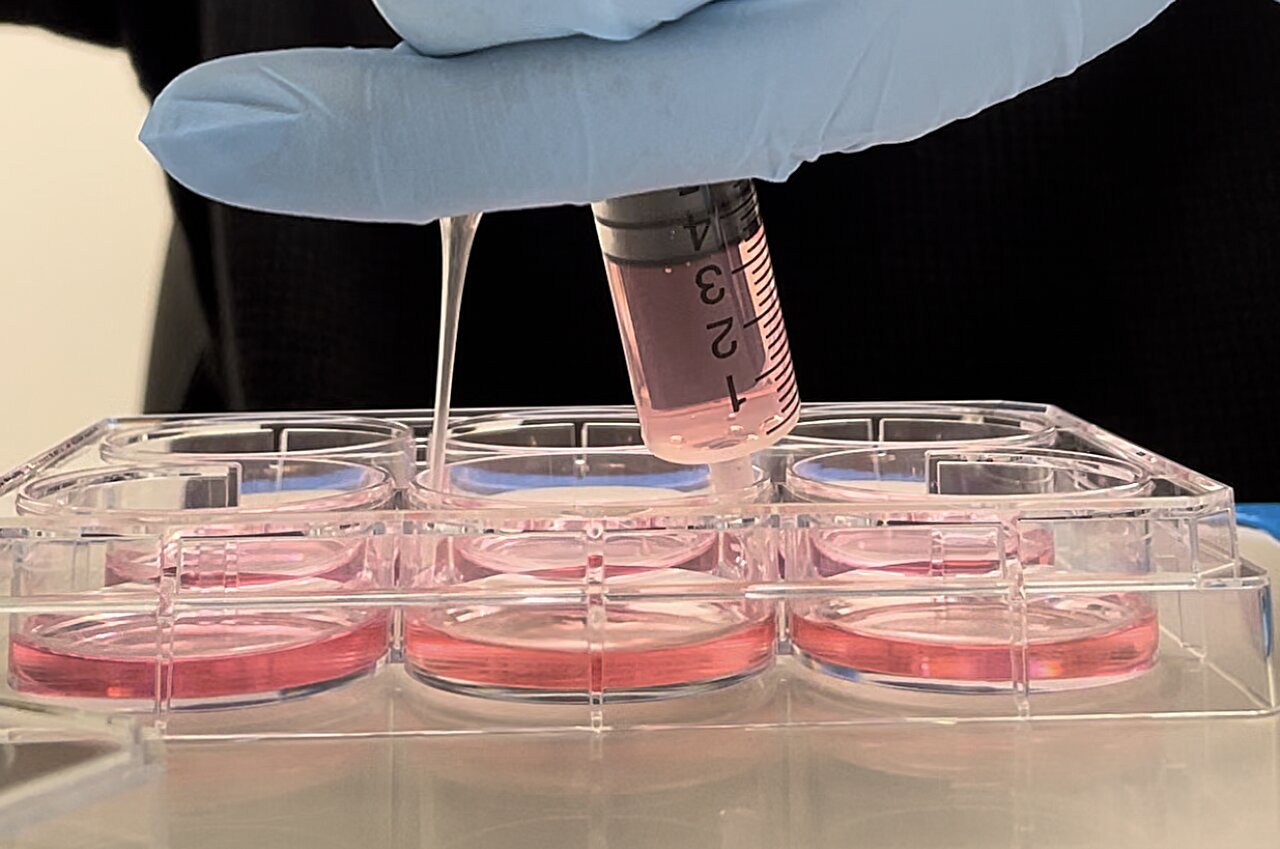

科学家用实验室培养的病毒成功治疗自身癌症

这位科学家将其自身癌症突破性地用实验室培养的病毒治疗成功,引发了伦理学上的讨论。她在先前切除乳房的部位发现了癌症复发,通过一种未验证的方法进行了自我治疗。在此过程中,她利用自身专业知识,自信地结合使用了两种已在临床试验中测试过的病毒。学术界对此的伦理担忧虽然存在,但这次成功也激励她在这一领域持续探索。原文链接:Scientist treated her own cancer with viruses she grew in lab。

IronCalc:突破传统电子表格引擎的开源先锋

IronCalc 是一个全新的开源电子表格引擎,旨在提供对现有解决方案的重要补充。它支持所有 Excel 常用功能,并且以 Rust 和 WASM 为基础,具备出色的跨平台兼容性和极速性能。评论中,很多开发者表示对于这款新工具感到振奋,并期待它未来的功能拓展和行业影响。

领先的开源代码大语言模型指南

OpenCoder 是一个完全开源的代码大语言模型(LLM)家族,不仅提供了模型权重和推理代码,还包含可复现的训练数据、完整的数据处理管道、严谨的实验消融结果和详细的训练方案,旨在推动科学研究的发展。尽管模型的具体性能相较于其他模型如何尚未明确,但诚如一位评论者所建议的,无论具体表现如何,这种开放的工作使得所有人都受益。另有用户分享了在测试中遇到的挑战,特别是在模仿和推理能力上的差异性。这些实验结果为代码 AI 的发展提供了开源地基。

同时,评论中也提到了一些观点:例如,有评论指出大部分顶级开源 LLM 模型来自中国,尽管该国在训练所需硬件方面存在限制,而另外也有用户提到了一些编码模型在不同程序语言上的表现不一。

OpenCoder: Open Cookbook for Top-Tier Code Large Language Models

Git 合并的革命:Mergiraf 语法感知合并工具

Mergiraf 是一款针对 Git 的语法感知合并工具,旨在解决开发者常见的代码合并冲突问题。虽然其架构设计精良,但某些情况下仍可能面临语法扩展带来的挑战。此外,它无法解决例如 Python 的某些语法相关问题。然而,Mergiraf 的设计初衷在于以非暴力的方式进行合并,使得代码融合更加和谐。更多信息请看 Mergiraf 官方网站。

探索亡灵国度的艺术杰作:解密《Grim Fandango》背后的故事

《Grim Fandango》是一款备受追捧的冒险游戏,因其独特的视觉风格和富有深度的叙事而闻名。作为 LucasArts 的经典之作,这款以 3D 技术开发的游戏,将墨西哥亡灵节的民间传说与经典黑色电影结合,创造出一个迷人的拉美风格冥界。虽然游戏因谜题设计的复杂性而略显棘手,但其美妙的艺术风格和引人入胜的剧情却为玩家提供了难忘的体验。值得一提的是,游戏首次使用了 Lua 语言,极大地推动了现代游戏开发的发展。

原文链接:Grim Fandango

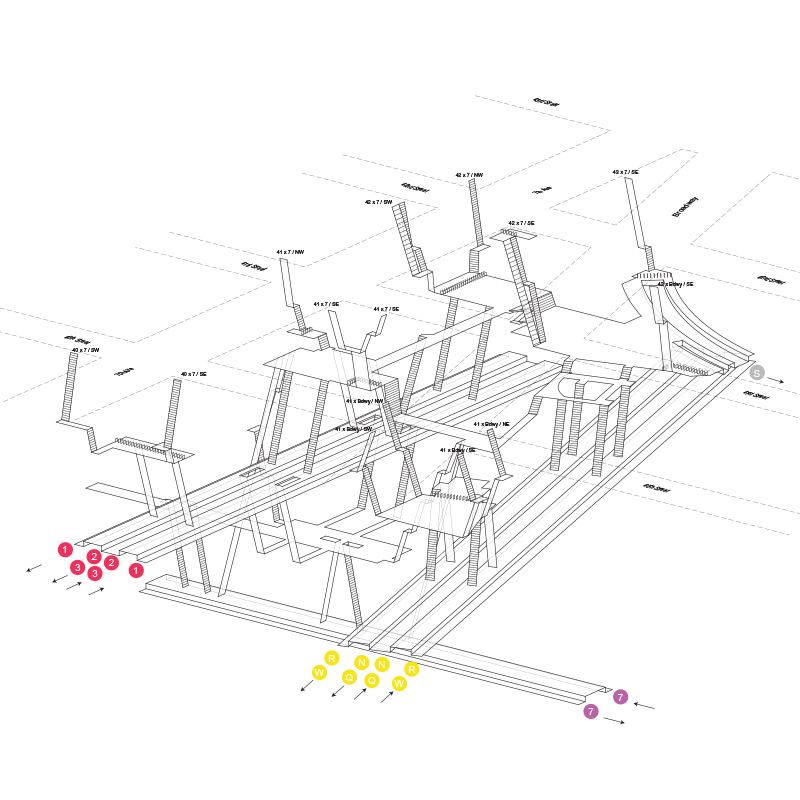

探索纽约地铁站的秘密布局

这篇文章探讨了纽约地铁站的独特布局设计,为城市通勤者提供了一个全新的视角。作者 gregsadetsky 创造了一系列详细的地铁站平面图,为乘客优化出行路径提供了有力工具。这些分析不仅仅关乎当地,还引发了关于全球其他城市地铁系统的广泛讨论。感兴趣的读者可以通过这篇链接了解更多信息。

记忆不仅储存在大脑:细胞研究的突破发现

近期的一项研究显示,记忆可能并不限于我们的大脑。该研究探索了细胞层面的学习过程,发现这些细胞的工作机制与大脑的神经元相似。这为理解偶然的记忆闪现和某些遗传信息传递提供了新的视角。正如评论中提到的,这似乎解释了一些关于“本能”的神秘现象。

原文链接:Memories are not only in the brain, human cell study finds

评论指出,这一发现引发了关于记忆和遗传信息在身体不同组织间传递的讨论,有评论者提到与此有关的著作如《身体从未忘记》。这种细胞学习表明,身体的某些结构可能通过非传统的方式记忆和处理信息。

无需纹理的文本渲染:开启字符绘制新视野

在现代计算图形学中,纹理是渲染文本的重要一环。然而,Texture-Less Text Rendering 探索了一种无需纹理的文本渲染方法,可以方便地在单个绘制调用中实现调试消息的显示。该方法利用 GLSL 着色器编程将字形信息直接在片元着色器中编码,实现了简化而高效的文本显示。这一技术为快速和临时的文本显示提供了可能性。

原文链接:Texture-Less Text Rendering

故事的评论区同样充满了精彩观点,其中一位用户指出,虽然该方法巧妙且有趣,但在尝试重现老旧电子广告牌效果时,视觉上并不完美。此外,现代 3D 引擎中常用的 SDF(Signed Distance Field)技术也是研究的一个方向。另一位用户则分享了一段历史,称这种技术类似于 BBC Basic 语言中旧式字形绘制方法。

当机器学习讲述错误的故事

在这篇引人入胜的文章中,作者 Jack Cook 探讨了机器学习在硬件安全研究中的应用。研究中展示了一种机器学习辅助的侧信道攻击,该攻击可以在现代浏览器中执行,从而揭示了机器学习模型被误解和滥用的风险。故事不仅探讨了技术细节,还分享了作者的个人成长经历及研究对其人生轨迹的影响。原文链接

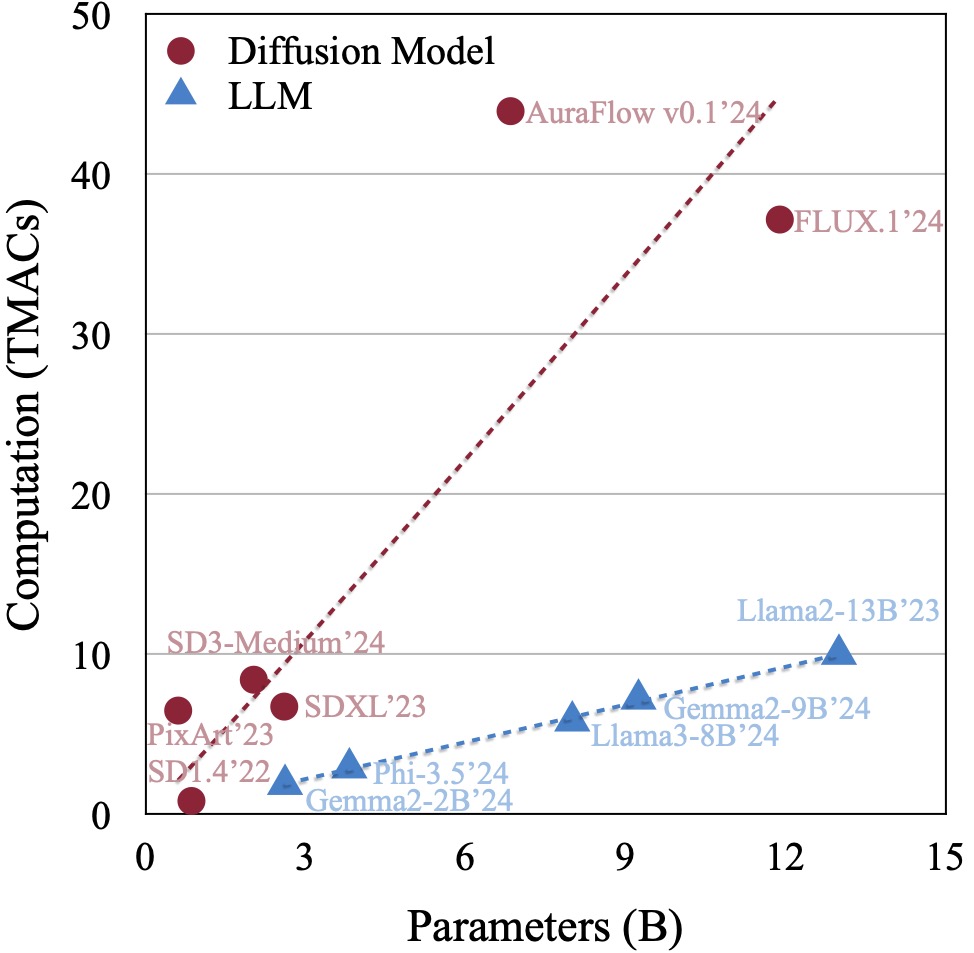

探索 SVDQuant:借助 4 位量化提高 GPU 效能三倍

在计算资源紧张的背景下,SVDQuant 提出的 4 位量化技术为 12B FLUX 模型带来了显著的内存和速度提升。与 BF16 模型相比,它在减少内存占用的同时,提高了在 16 GB RAM 的 4090 GPU 上的处理效率,并减少了 CPU 的工作负担。虽然此类模型可能在性能上存在一定的妥协,但它们的轻量化特性使其在实际操作中更为高效。

原文链接:SVDQuant: 4-Bit Quantization Powers 12B Flux on a 16GB 4090 GPU with 3x Speedup

262

262 1

1