很多人在催更《全球大模型季报》的2025年第一集,在Q1的最后一天,终于和大家见面了!

这一集广密依然带来了信息满满的有关于全球大模型最新的的前沿认知。经历了最近几个月的全球AI格局巨变,他最大的变化是,重新坚信了Pre-training(预训练)——认为只有Pre-training才能决定模型内在的上限,涌现新能力,而Post-training+RL(后训练+强化学习)是加强。

在这一集季报中,我们对于Q1的全球明星DeepSeek、作为模型“盗火者”的Manus、OpenAI的烟雾弹、硅谷的认知分歧与价值观、未来的范式级新路线,都进行了一一讨论。更重要的是,他更新了在一位AGI原教旨主义者的眼中,AGI的主线、珠峰与路途。

希望《全球大模型季报》能持续陪伴你,2025,我们和AI共同进步!

我们的播客节目在腾讯新闻首发,大家可以前往关注哦,这样可以第一时间获取节目信息和更多新闻资讯:)

04:22 Pre-training叙事卷土重来

今天最大非共识是Pre-training空间还非常大,Pre-training决定了模型内在的上限

还是要再喊一下,大家还是要重视Pre-training了,这个最本质

OpenAI现在不那么重视Pre-training,为什么?OpenAI的Pre-train核心团队一直挺动荡

11:56 Coding是最通用赛博世界的环境,是模型的手

我对两年内实现AGI有前所未有的信心

Coding意义不在于编程本身,而在于Coding是数字经济GDP活动最重要的环境,是最通用的赛博世界的环境

Coding是比搜索引擎和推荐引擎重要的东西

19:55 OpenAI vs Anthropic:战略是不同组织能力的表达

OpenAI和Anthropic同宗同源,最开始路线一样,但走着走着,核心战略bet或路线已经发生了分化

OpenAI是frontier team做出了O系列,frontier team的老大Mark Chen现在成为了仅次于Sam/Greg的三号人物

硅谷的认知分歧?这个问题本质是:智能重要,还是流量重要?

我有点担心OpenAI过早的走向一家消费互联网公司

30:18 一位AGI原教旨主义眼中的AGI roadmap(路线图)

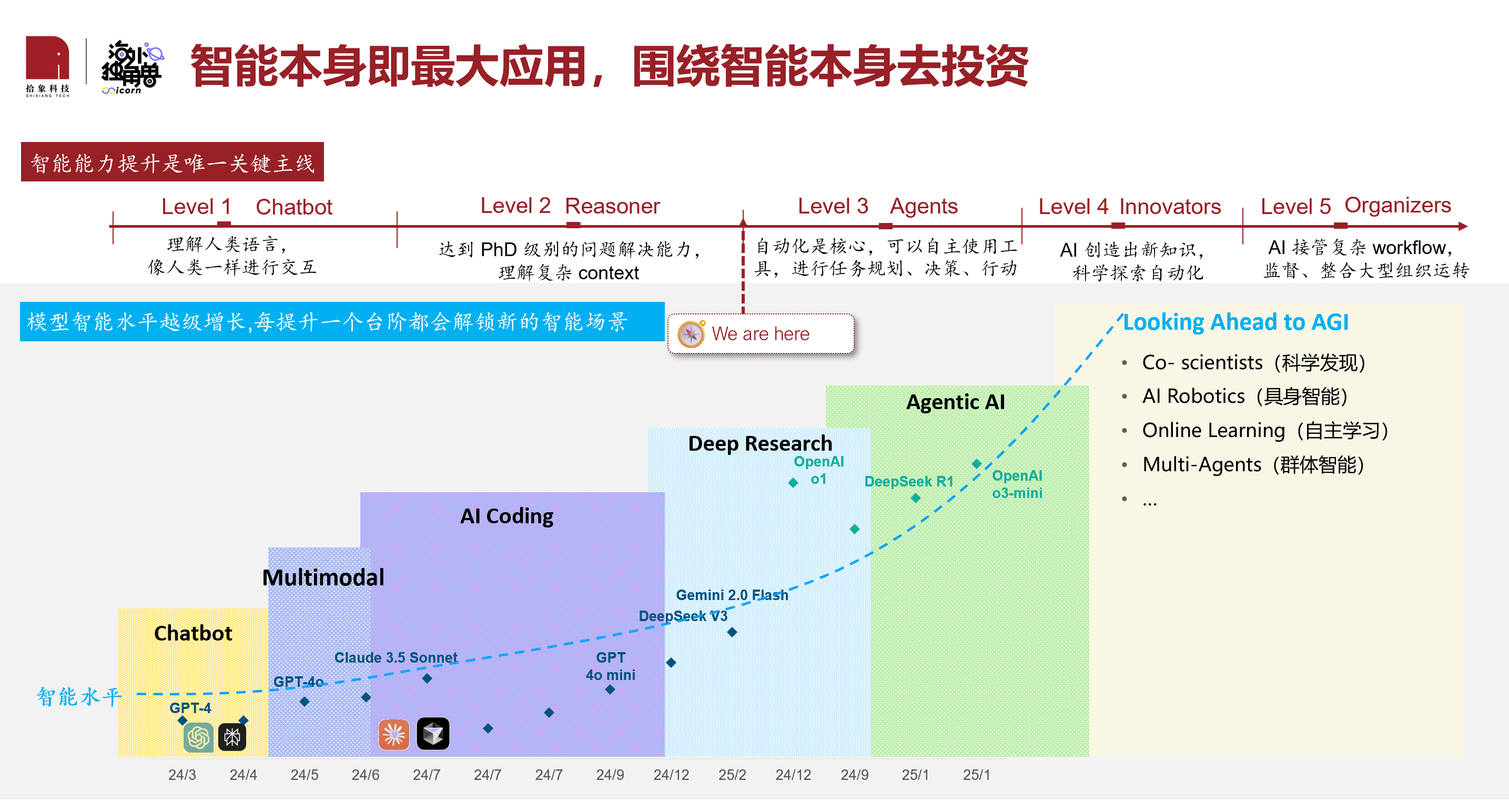

智能提升是唯一主线,智能本身就是最大应用

今天回头看,ChatGPT只是这座高山山脚的第一站,后面还有很多个山头:Coding、Coding Agent、General Agent、AI for Science、Robotics

ChatGPT只是前菜,接下来Agent才是正餐

今天还是围绕智能主线,最重要的是push智能能力往上走,做应用的要构建一个环境或容器,承接研究溢出的智能红利

文生图有可能是OpenAI烟雾弹

今天做Robotics Foundation model/Research的做法不够本质

26/27年可能是AI for Science爆发的时间点

43:00 智能的本质是什么?

这是个极好的问题——大家有想法可以打在评论区:)

人类进化就3个关键词:1. 生存,2. 探索,3. 自动化

智能进步的衡量标志是什么?

一个Chatbot对话可能消耗几千个Token,一个Perplexity搜索大概几十K Token,但一个Manus平均可能要70-80万个Token

48:03 Agent是新物种

“智能水平离AGI越近,可能就越像宇宙大爆炸”

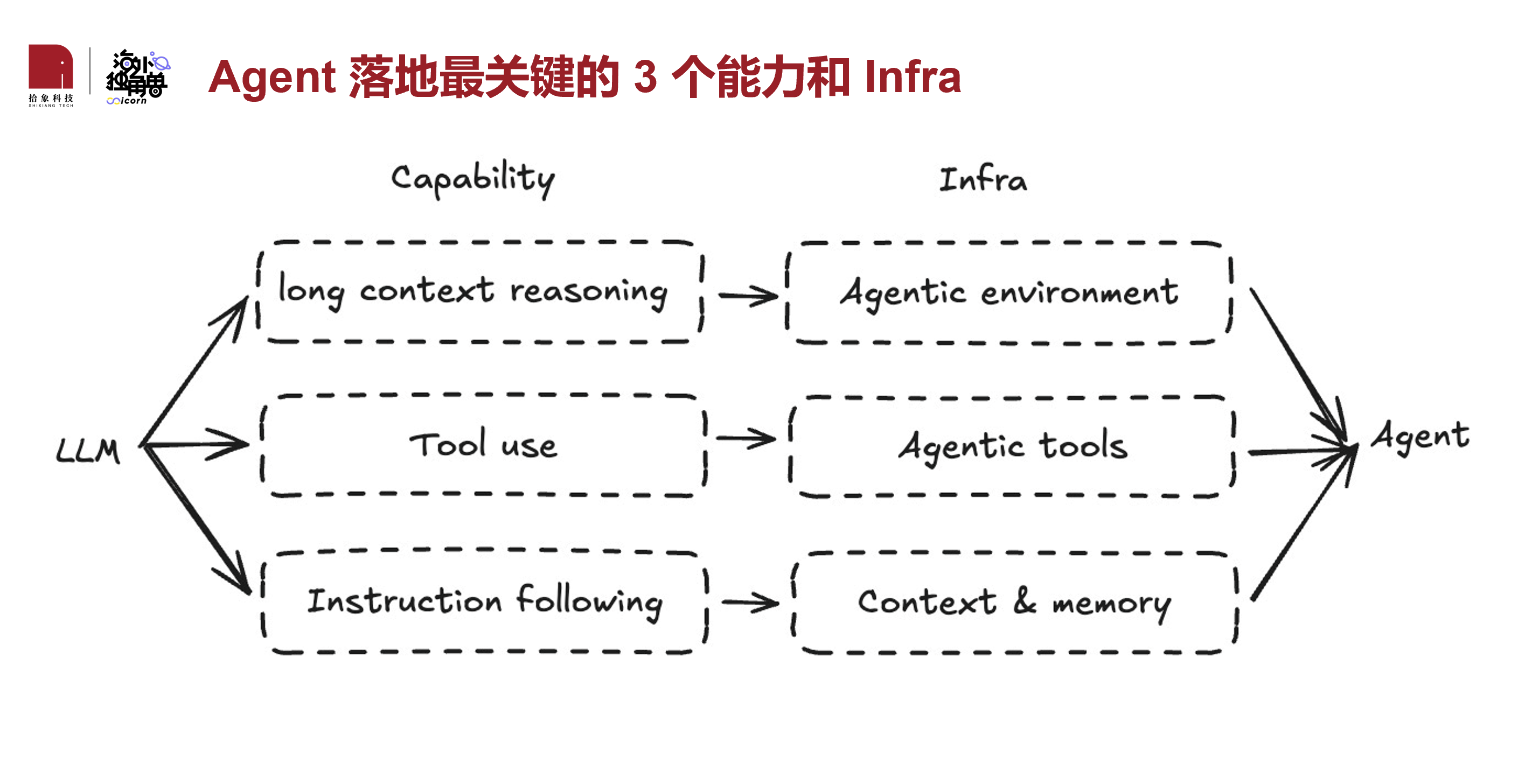

Agent落地最关键的3个能力:1. Long Context reasoning, 2. Tool use, 3. Instruction following指令遵循

AGI接下来的milestone是long-term memory,这个会取代long context

55:49 未来范式级的路线,可能Online Learning是一个

如果说未来还有范式级的路线,可能Online Learning是一个,让模型可以在线自主探索并学习

对GPU或者英伟达叙事影响有多大?

怎么看待贾扬清的公司(Lepton AI)被卖掉?英伟达在下一盘什么大棋?

01:02:45 模型与产品的关系、壁垒和商业模式

今天定价为什么20美元,是copy SaaS的定价吗?但SaaS不会消耗大量token

裸模型发布的时代即将结束?形成壁垒主要是两个:一是成为Cloud,OpenAI自己变成微软的Azure Cloud;二是成为OS,要有生态,后面打造新的Operating System

投资人怎么投AI应用?

模型长期会把产品吃掉吗?本质是,feature system vs Learning system哪个更快

Perplexity/Cursor/Manus都是“模型的盗火者”

01:15:11 全球大模型公司竞争格局和全球AI产品公司

GPT-4.5算不算领先?GPT-5为什么一直在跳票?OpenAI有没有失败的风险?

怎么看待OpenAI支持了Anthropic的MCP协议?OpenAI和微软为什么会有裂痕?分家对微软影响多大?

Manus vs Perplexity,都是执行力很强的团队,被称作“套壳之王”

理想的投资组合:25% Anthropic, 25% Bytedance, 10% OpenAI, 10% Mira Thinking Machine Lab, 5% SSI, 5% Cursor, 5% Manus, 另外15%还没想好

如果DeepSeek融资,我会放基金的25%

01:54:32中美格局:如何跨越地缘封锁

科技投资不是靠“混”能混出结果的,很多VC investor到处混圈子,其实没意义,还是得靠“创造”

【全球大模型季报】系列

2023年:口述全球大模型这一年:人类千亿科学豪赌与参差的中美景观

2024年Q1:和广密聊AGI大基建时代:电+芯片=产出智能

2024年Q2:口述全球大模型这半年:Perplexity突然火爆和尚未爆发的AI应用生态

2024年Q3:AGI范式大转移:和广密预言草莓、OpenAI o1和self-play RL

2024年Q4:大模型季报年终特辑:和广密预言LLM产品超越Google之路

【免责声明】

单纯内容分享,不作为投资建议。

【更多信息】

联络我们:微博@张小珺-Benita,小红书@张小珺

更多信息欢迎关注公众号:张小珺

32079

32079 225

225